Czemu tak trudno rozpoznać deep fake?

Dezinformacja to plaga współczesności. Rozpoznanie jej „gołym okiem” jest często prawie niemożliwe, a narzędzia służące do pogłębionej analizy i wykrywania tzw. deep fake – choć istnieją – są wciąż dalekie od ideału.

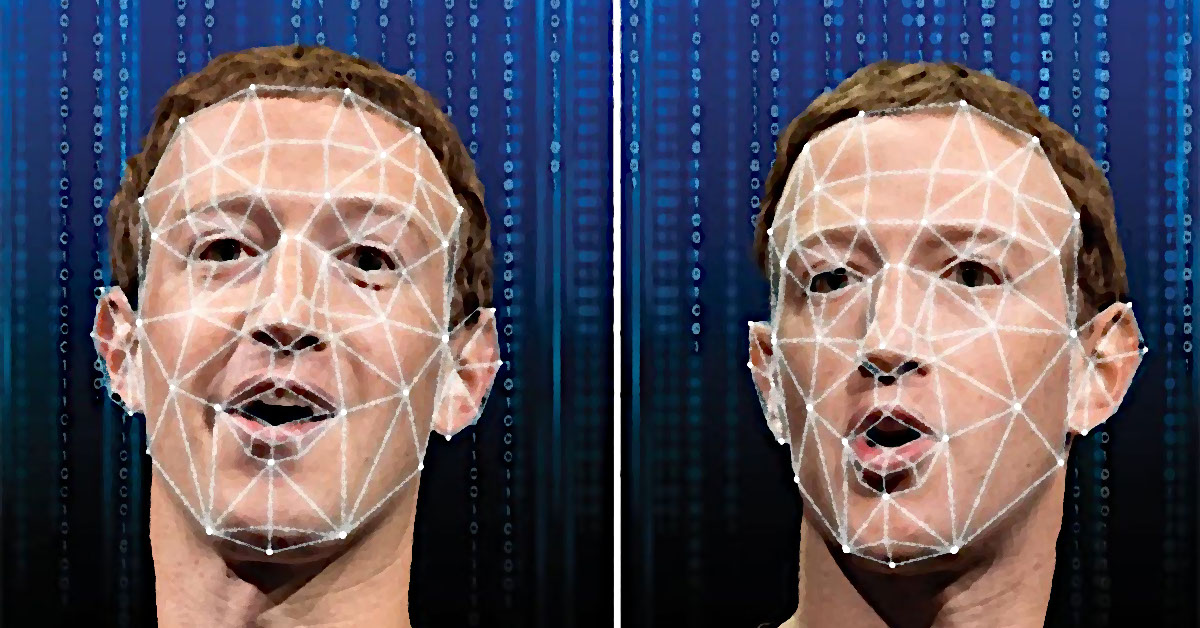

Rozpowszechnienie się sztucznej inteligencji ułatwia nie tylko automatyzację pracy, copywrighting, generowanie grafik ilustracyjnych czy przekształcanie tekstu w mowę. To również genialne narzędzie do tworzenia deep fake’ów – przetworzonych przez AI obrazów lub filmów wykorzystujących wizerunki prawdziwych osób umieszczonych w fikcyjnych sytuacjach lub mówiących rzeczy, których nigdy nie powiedzieli. Odróżnienie takich treści od rzeczywistych nagrań danej osoby jest często bardzo trudne. Technologię tę stosuje się do wielu celów, od nieszkodliwych memów do oszczerstwa i szantażu, np. przez zedytowanie filmu pornograficznego w taki sposób, by zamiast twarzy aktora umieścić tam wizerunek znanej osoby. Przykłady można mnożyć.

Trudność w rozpoznawaniu deep fake’ów czyni z nich niebezpieczne narzędzie o dużej sile rażenia. Choć w miarę rozrostu zjawiska tego typu dezinformacji powstaje również coraz więcej programów mających za zadanie wyłapywać fałszywe treści spreparowane przez sztuczną inteligencję, ich efektywność wciąż jest daleka od ideału. Shirin Anlen i Raquel Vázquez Llorente, członkinie organizacji WITNESS, przeanalizowały działanie niektórych takich narzędzi, próbując znaleźć odpowiedź na pytanie, gdzie leży przyczyna ich częstego braku skuteczności. Ich artykuł został opublikowany przez Reuters Institute.

Deep fake – jak oszukać system?

Dokładność modelu AI zależy od ilości, jakości oraz typu danych, na jakich został wytrenowany, a także od samego swojego przeznaczenia. Algorytm, który uczył się rozpoznawać sztukę wygenerowaną przez sztuczną inteligencję, może nie radzić sobie z rozróżnianiem „prawdziwych” filmów od deep fake’ów. Podobnie jest mniejsza szansa, że program nauczony przede wszystkim wizerunków bardzo znanych osób prawidłowo rozpozna fałszywe treści wykorzystujące twarz kogoś mniej rozpoznawalnego; program wyszkolony na nagraniach wysokiej jakości będzie mniej dokładny w analizie treści, w których jest wiele zakłóceń, itd.

Autorki przywołują przykłady kilku popularnych deep fake’ów, takich jak zdjęcie rzekomej eksplozji w Pentagonie z maja 2023 r. czy spreparowane nagranie Baracka Obamy. Mimo że algorytm do wykrywania fałszywych treści prawidłowo oznaczył je jako nieprawdziwe, kiedy kazały mu przeanalizować tylko wycinek obrazu lub jego mocne przybliżenie, narzędzie nie rozpoznało już fake’u. Usuwanie niektórych metadanych pliku – niekoniecznie specjalnie, może się to dziać bowiem np. podczas kompresji wideo wrzucanego na platformę społecznościową – również jest w stanie zaburzyć wynik, zmniejszając prawdopodobieństwo prawidłowego rozpoznania deep fake’a.

Warto pamiętać, że fałszywe, dezinformujące treści często nie są w całości stworzone przez sztuczną inteligencję, co dodatkowo utrudnia ich wykrywanie; edycji przez AI może być poddany tylko fragment zdjęcia czy nagrania.

Edukacja i rozsądek

Funkcjonowanie deep fake w przestrzeni publicznej podkopuje zaufanie w prawdziwość informacji, i to nie tylko tej podawanej przez internet – wszak tradycyjne media często same łapią się na dezinformację i podają ją dalej. Autorki publikacji podkreślają, że programy służące do wykrywania wygenerowanych przez AI treści mogą być użytecznym narzędziem, ale należy podchodzić do nich krytycznie i z rozwagą. Zwracają uwagę na konieczność ciągłego rozwijania i udoskonalania modeli, tak jak rozwijają i udoskonalają się algorytmy używane do szerzenia dezinformacji. I przede wszystkim: jako konsumenci informacji musimy sami uczyć się weryfikować docierające do nas treści oraz być wyczuleni, że – im bardziej są sensacyjne, szokujące i nośne – tym większa jest szansa, że ziarno prawdy jest w nich niewielkie bądź nie ma go wcale.

Joanna Talarczyk